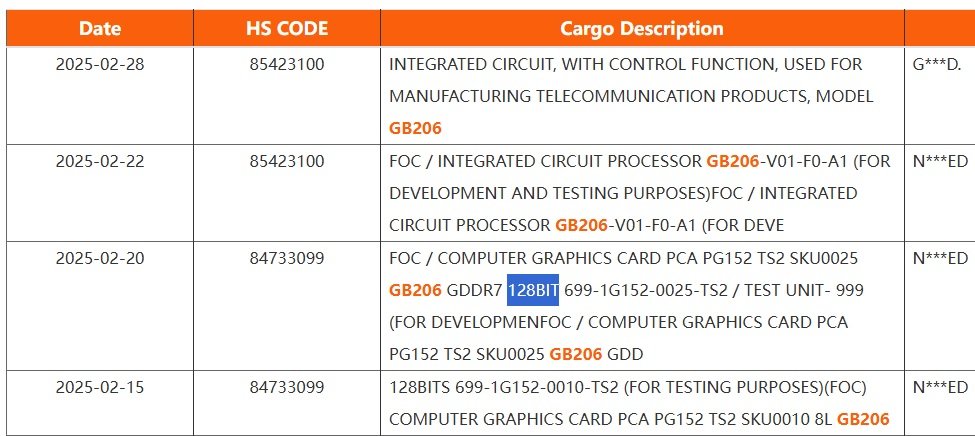

A RTX 5090D tem reinado absoluta no ranking do HWBot para testes de benchmark com overclock extremo. Até o momento desta postagem, a placa aparece em primeiro lugar em todos os testes do 3DMark, além de alguns outros menos conhecidos também. E a explicação pode estar no modelo que tem sido usado para obter essas pontuações.

Na geração atual de placas de vídeo para o segmento doméstico, tanto AMD como Intel decidiram não concorrer com a NVIDIA em modelos high-end. Assim, seria de se esperar que a RTX 5090 ficasse na frente em rankings de pontuação obtida com overclock. No entanto, é o modelo 5090D exclusivo para a China que tem se saído melhor.

O que chama a atenção neste caso é que a RTX 5090D é justamente uma 5090 “piorada”, para que a NVIDIA consiga permissão de vender a GPU na China. O segredo estaria no modelo customizado usado nos testes, a Galax HOF Edition.

Essa placa nem teve seu lançamento oficial ainda e já apareceu nas notícias no início de março, quando quebrou o recorde do 3DMark Speed Way. Como mostram as imagens neste post, agora a placa também fica na frente no Port Royal, Vantage Extreme, Time Spy Extreme e Fire Strike Extreme. Ela também leva vantagem no Unigine Superposition:

Por que a Galax RTX 5090D HOF Edition fica na frente da RTX 5090?

O grande diferencial deste modelo específico da RTX 5090D é a presença de dois conectores de 16 pinos para energia. Nos resultados recordistas podemos ver a GPU alcançando entre 1.500W a 1.600W no consumo de energia.

Obviamente, não basta oferecer tanta energia para uma placa sem tomar medidas para garantir que ela não vai queimar. É por isso que o PCB das Galax HOF Edition vem preparado para facilitar o uso de resfriamento por nitrogênio líquido (LN2), voltado para overclock extremo.

Notícias relacionadas:

- GALAX RTX 5090D HOF XOC atinge 3,27 GHz e quebra recorde mundial de overclock

- RTX 5090D chega a 3,4GHz em overclock, e bate pontuação de duas RTX 3090 Ti no Port Royal

- Diversos usuários reportam problemas com a RTX 5090 após atualização de driver

A Galax RTX 5090D HOF Edition provavelmente continuará restrita à China em sua distribuição oficial. Segundo o Tom’s Hardware, no momento não existe uma RTX 5090 com dois conectores de 16 pinos, então é possível que os chineses continuarão dominando o ranking do HWBot por um bom tempo ainda.